Was ist MCP? Einfache Erklärung mit technischem Tiefgang

Veröffentlicht am 13.03.2026

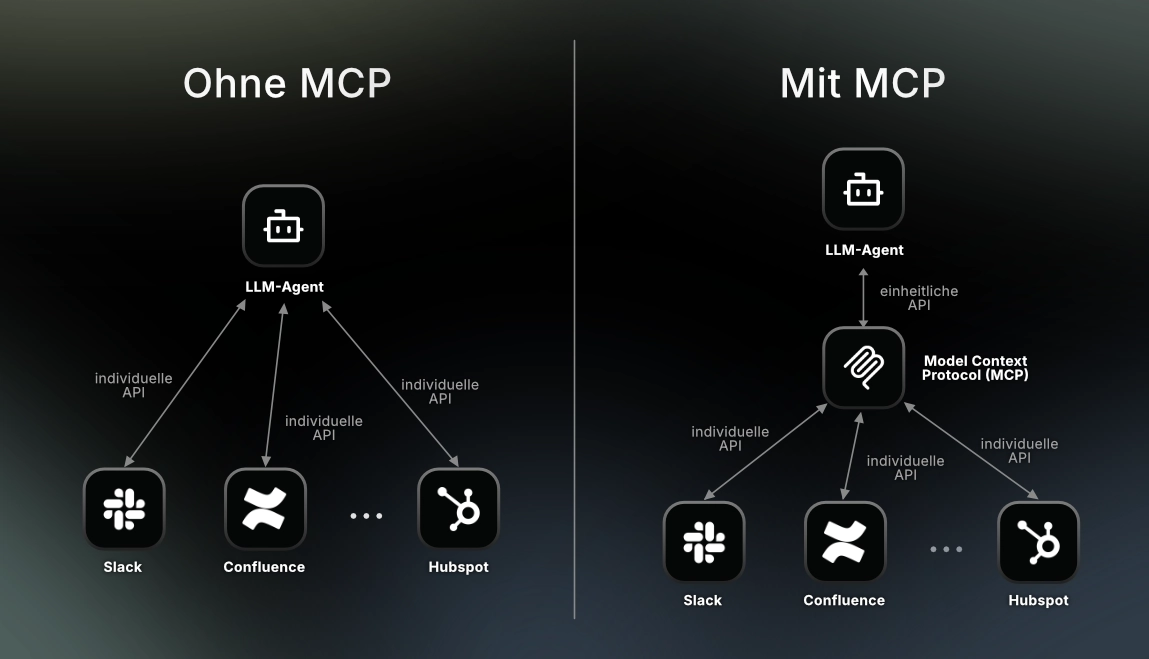

Was ist das MCP-Protokoll? Standardisierte Kommunikation für KI-Agenten

IT-Systeme gewinnen an Wert, wenn sie Daten effizient austauschen. Das galt auch schon vor der KI-Ära. Doch mit dem Aufkommen großer Sprachmodelle (LLMs) wird Kontext zum entscheidenden Faktor für die Qualität von KI-Ergebnissen. Hinzukommt der steigende Bedarf, KI-Agenten mit externen Systemen interagieren zu lassen, ohne dabei jedes Mal manuelle Code-Anpassungen oder komplexe API-Integrationen durchführen zu müssen.

Das Model Context Protocol (MCP), standardisiert genau diesen Datenaustausch. Es vereinfacht die Interaktion zwischen KI-Systemen und Anwendungen, indem es klassische APIs meist in eine LLM-freundliche Abstraktionsschicht überführt und um für LLMs konsumierbare Features erweitert.

Für wen ist dieser Artikel relevant?

Dieser Artikel richtet sich an Entscheidungsträger:innen, Entwickler:innen und Projektverantwortliche, die den Nutzen von MCP bewerten und Anforderungen ableiten möchten. Dieser Artikel erklärt die Konzepte verständlich und praxisnah, ohne dass tiefes KI- oder Software-Vorwissen erforderlich ist.

Warum MCP? Wie MCP die Lücke zwischen klassischen APIs und LLM-basierten KI-Systemen schließt

Bevor wir uns nun MCP genauer anschauen, hilft es, einen Schritt zurückzugehen. Wie Interagieren wir Menschen eigenltich mit Applikationen? Was pasiert im Hintergrund, wenn Systeme Daten miteinander austauschen? Wieso sind bisherige Ansätze ggf. nicht ideal für die KI-Ära?

Klassische APIs: Bewährt, aber nicht KI-optimiert

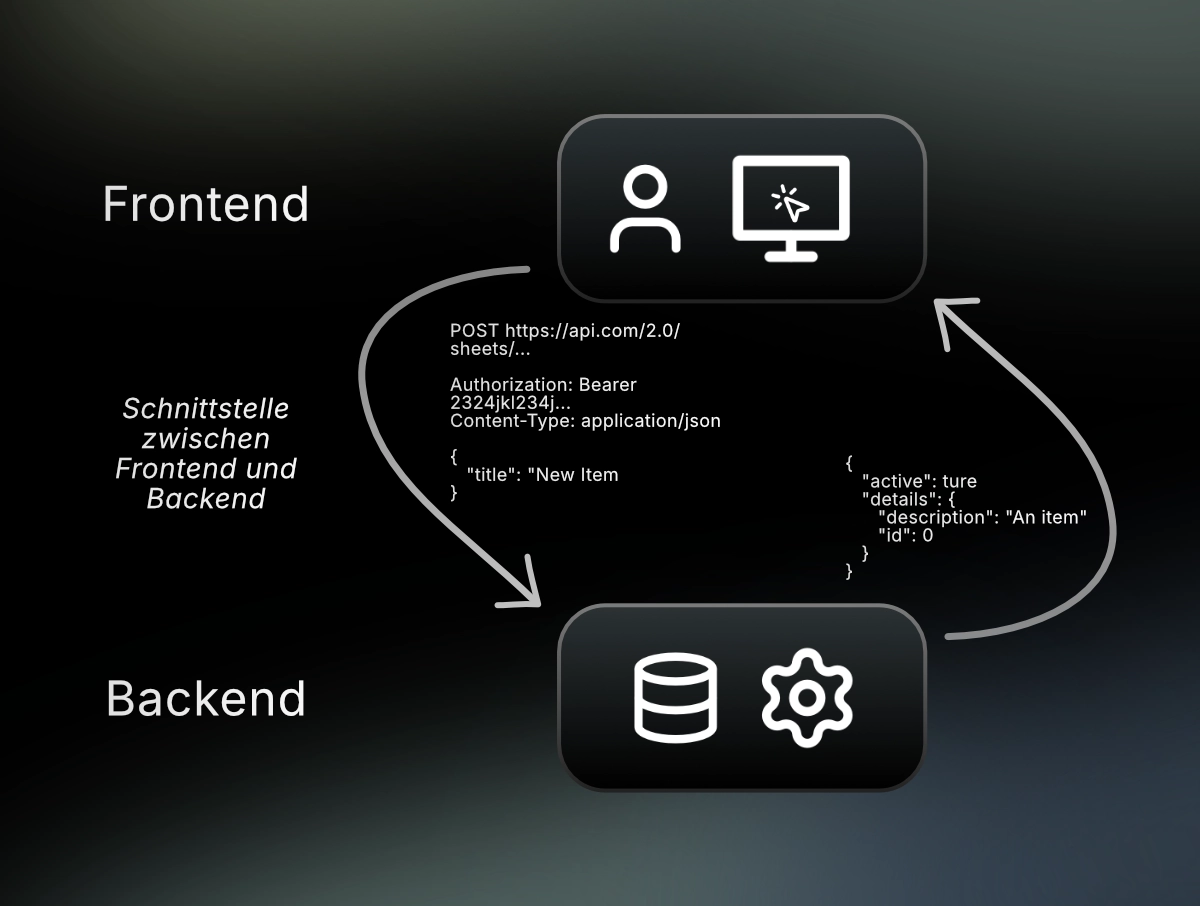

Aktuell interagieren Menschen mit Anwendungen meist über grafische Oberflächen (GUIs). Daten werden für uns verständlich visualisiert und z.B. über Buttons oder Input-Felder etc. können wir mit der Anwendung interagieren.

Im Hintergrund sorgt fest programmierte Logik dafür, dass unsere Interaktionen in dem System korrekt verarbeitet bzw. gespeichert werden oder die Daten in andere Systeme übertragen werden. Wir als Nutzer müssen uns nicht darum kümmern, dass z.B. die Daten korrekt in der Datenbank hinterlegt werden.

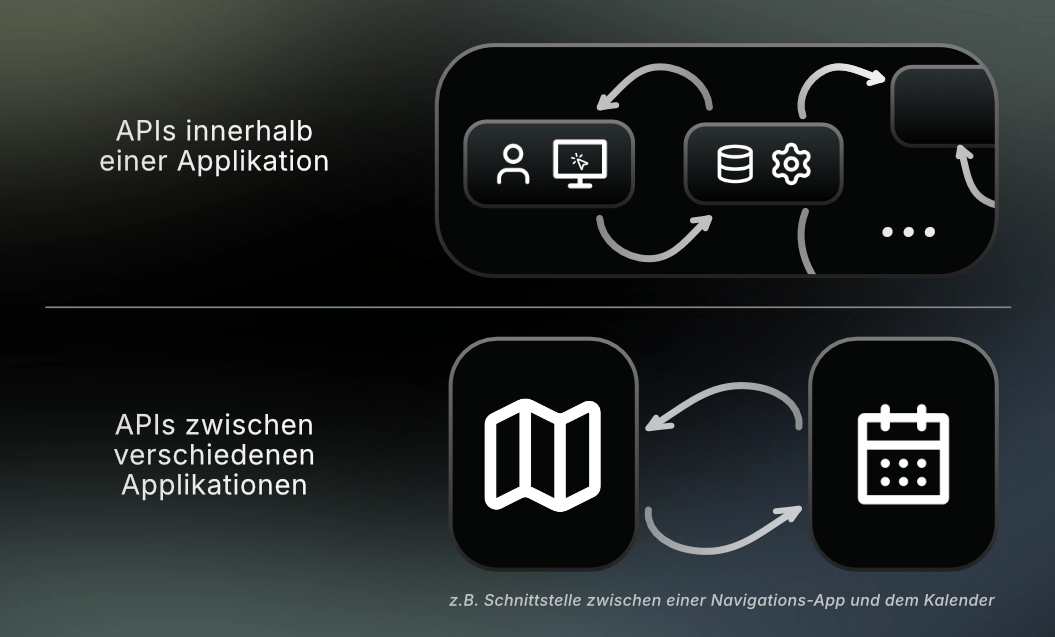

Diese Stellen, an denen sich verschiedene Systeme “schneiden” und Daten austauschen, nennt man Schnittstellen oder auf Englisch „Application Programmable Interface“, kurz APIs. Beispiele hierfür könnten sein:

- APIs innerhalb einer Applikation: z.B. API zwischen Frontend (GUI) und Backend (Datenbank) (APIs innerhalb einer Appli)

- APIs zwischen verschiedenen Applikationen: z.B. die Navigations-App greift auf den Kalender zu und weiß dann, wo der nächste Termin ist, zu dem man möchte.

Damit Computersysteme verstehen, wie sie diese Daten austauschen können, muss genau festgelegt sein, in welchen Formaten die Systeme die Daten erwarten.

Für menschliche Nutzer:innen ist diese Komplexität, wie bereits erwähnt, meist über eine grafische Oberfläche (GUI) wegabstrahiert.

Für LLMs ist diese Interaktion mit grafischen Oberflächen, die für Menschen optimiert sind, allerdings nicht trivial.

APIs im Zeitalter von LLMs

LLMs hingegen “lieben” Text. Schließlich ist das ihr Anwendungsfall. Sie sind so modelliert, dass sie gut mit Text interagieren. API-Spezifikationen und Code sind letztlich Text. Wie könnte ein LLM nun mit der API einer anderen Applikation interagieren?

Ein naiver Ansatz könnte folgender sein:

- Wir geben dem LLM die API-Spezifikation, der Applikation, mit der interagiert werden soll.

- Das LLM analysiert die API-Spezifikation

- Dann müsste das LLM gemäß der API-Spezifikation Code generieren für die Interaktion, die durchgeführt werden soll.

- Letztlich müsste dieser Code dann ausgeführt werden und das Ergebnis wieder an das LLM bzw. den LLM basierten KI-Agenten zurückgeführt werden.

Beachtet man, wie divers verschiedene Anwendungen sind (z. B. Kalenderprogramm, Mailprogramm, Musik-App etc.) und wie vielfältig und fragmentiert APIs von unterschiedlichen Anwendungen sein können, kann man zum plausiblen Entschluss kommen, dass dieser naive Ansatz vermutlich nicht zuverlässig skaliert. Hinzukommt noch, dass der KI-Agent mit diesem einfachen Ansatz, wenn man keinen Speicher / Cache implementiert hat, jedes Mal die komplette API-Spezifikation analysieren und jedes Mal neu Code für die Aufrufe generieren müsste und dieser müsste in einer passenden Umgebung ausgeführt werden. Security-Themen wie Authentifizierung sind in diesem naiven Ansatz noch nicht mal berücksichtigt.

Was ist also, wenn man den komplexen Teil, also die API-Interaktionen und das Ausführen der Request für ein LLM, wegabstrahiert? Sodass sich das LLM bzw. der LLM-basierte KI-Agent darum nicht kümmern muss.

Das ist unter anderem die Idee von MCP.

Der LLM-basierte KI-Agent soll rein über Umgangssprache „verstehen“, wie die Daten abgefragt werden können und mit Applikationen interagiert werden kann.

Aufbau von MCP

Ende 2024 Anropic (das Unternehmen hinter unter anderem Claude) ein neues standardisiertes Format vor: das Model Context Protocol, kurz MCP. Es soll den Datenaustausch zwischen KI-Systemen (insbesondere großen Sprachmodellen (LLMs)) und externen Systemen erleichtern.

In anderen Worten: Das Model Context Protocol (MCP) standardisiert, wie externe Systeme (Applikationen, Datenbanken etc.) Kontext für LLMs bereitstellen können. Der erhoffte Mehrwert ist, dass …

- … LLM-basierte KI-Agenten sich den für die Aufgabe relevanten Kontext bei externen Applikationen erfragen können.

- … LLM-basierte KI-Agenten Aktionen in anderen Systemen anstoßen können.

MCP ist eine für LLMs besser verarbeitbare Abstraktionsschicht von klassischen APIs

Um die “Magie” von MCP besser zu verstehen, hilft folgender Gedanke: MCP ist meist kein Ersatz für klassische APIs, sondern eine Abstraktionsschicht darüber.

MCP abstrahiert, den komplexen Teil in der Interaktion mit klassischen APIs, optimiert für LLMs weg.

Wie funktioniert MCP technisch?

In der Praxis stellt MCP somit meiste eine für LLMs besser verarbeitbare Abstraktionsschicht von klassischen APIs dar. Die Interaktion mit dem eigentlichen System wird in einem MCP-Server gekapselt und für ein LLM-basierten KI-Agenten in einem MCP-Client konsumierbar gemacht. Vereinfacht beschrieben: Ein LLM hat nun die Möglichkeit, über MCP in “Umgangssprache” zu erfragen, welche Ressourcen, Tools und Prompt-Templates zur Verfügung stehen (was genau das ist, folgt gleich). Wenn sich der LLM-basierte KI-Agent “entscheidet”, etwas davon zu nutzen, wird im Hintergrund entsprechende Logik auf dem MCP-Server ausgeführt (z. B. die Interaktion mit bestehenden APIs). Der KI-Agent muss sich also nicht um die komplexte Integration mit dem externe System beschäftigen, sonder bekommt nach erfolgreicher Anfrage das Resultat wieder in für ein LLM verständlichem Format zurückgemeldet.

Elemente des MCP-Servers

Ein MCP-Server stellt typischerweise bis zu drei Arten von Elementen für LLMs zur Verfügung:

- Tools

- Resourcen

- Prompt-Templates

Nicht jeder MCP-Server verwendet allerdings alle diese Arten.

Tools (Aktionen)

Tools sind ausführbare Funktionen, die der MCP-Server bereitstellt, um LLM-basierten KI-Agenten Aktionen in externen Systemen zu ermöglichen (z. B. API-Aufrufe, Datenbankoperationen).

Mehrwert:

- Automatisierung: LLMs können Tools direkt aufrufen, ohne manuell Code schreiben zu müssen.

- Sicherheit: Berechtigungen und Parameter werden serverseitig validiert.

- Abstraktion: Komplexe APIs werden für LLMs als einfache, standardisierte Funktionen dargestellt.

Resources (Daten)

Resources sind statische, lesbare Daten (read-only), die der Server für LLM-basierten KI-Agenten, ohne Seiteneffekte bereitstellt.

Mehrwert:

- Kontextbereitstellung: LLMs erhalten strukturierte Informationen, um bessere Entscheidungen zu treffen.

- Effizienz: Reduziert Token-Verbrauch, da Daten direkt referenziert werden können.

- Aktualität: Dynamische Resources (z. B. Datenbank-Snapshots) halten LLMs auf dem aktuellen Stand.

Prompt-Templates (Struktur)

Vordefinierte Prompt-Vorlagen, die LLMs als Ausgangspunkt für Aufgaben nutzen können. Enthalten oft Platzhalter für dynamische Inhalte.

Mehrwert:

- Konsistenz: Standardisierte Prompts führen zu vorhersehbaren Ergebnissen.

- Beschleunigung: LLMs müssen nicht bei Null anfangen (z. B. für wiederkehrende Aufgaben wie E-Mail-Antworten).

- Compliance: Vorlagen können das Einhalten von Richtlinien (z. B. Tonfall, rechtliche Hinweise) erhöhen

Vor- und Nachteile sowie Grenzen von MCP

Vorteile:

- Standardisierung von Integrationen: Ein gemeinsamer Weg, wie Agenten mit Systemen sprechen, statt für jeden Use Case API-Spezifikationen und Integrationen individuell anpassen zu müssen.

- Klarer Kontext: Der Agent weiß, welche Tools es gibt, wie sie funktionieren und in welchem Rahmen er sie nutzen darf.

- MCP hat sich bei der Interaktion zwischen KI-Agenten und externen Applikationen als Standard etabliert und ist mittlerweile weit verbreitet.

Nachteile und Limits:

- Halluzinationen führen zu Fehlverhalten: Es besteht das Risiko, dass der KI-Agent die falschen Tools nutzt oder Tools nicht korrekt nutzt (z.B. mit falschen Inputwerten).

- Beispiel: Über MCP wird es einem KI-Agenten ermöglicht, Tickets in einem Projektmanagement-Tool zu erstellen, zu bearbeiten und zu löschen. Es ist nun möglich, dass der KI-Agent aus Versehen das Tool “delete_ticket” aufruft und ggf. das falsche Ticket löscht.

- MCP ist kein “magischer” KI-Booster: Es ist entscheidend, dass die Prozesse im Hintergrund klar funktionieren und gute Daten bereitgestellt werden.

- MCP ist kein Ersatz für saubere Architektur, Security und Berechtigungsmanagement

MCP ist das Protokoll, nicht der Use Case. Der Wert entsteht dort, wo konkrete Geschäftsprobleme mithilfe von KI-Agenten gelöst werden können. MCP erleichtert hierbei die Umsetzung bzw. stellt einen mittlerweile weitverbreiteten Standard zur Verfügung.

Zielgruppen und Anwedungsfälle

MCP eignet sich besonders für:

- Unternehmen, die KI-Agenten in bestehende Systemlandschaften integrieren möchten

- Entwicklungsteams, die Komplexität von API-Anbindungen für KI-Agenten reduzieren wollen

- Teams, die KI-Prozesse beschleunigen und fehlerrobuster gestalten wollen

Beispiel: Ein Kundenservice-KI-Agent greift auf CRM-Daten zu, dann auf eine interne Wissensdatenbank mit Best Practices, erstellt daraufhin neue Tickets im Projektmanagement-Tool und aktualisiert den Status.

Fazit: MCP als Enabler für KI-Integration

Das Model Context Protocol schließt eine wichtige Lücke: Es macht bestehende APIs für LLM-basierte KI-Agenten kompatibel und erweitert klassische Ansätze von Systemintegration, um für KI‑Agenten relevante Aspekte (wie z. B. Prompt-Templates). Für Unternehmen, die KI-Agenten produktiver einsetzen wollen, bietet MCP mehr Autonomie zu geringem Aufwand und erhöht die Interaktion mit der IT-Systemlandschaft, was den Nutzen von KI-Agenten erheblich steigern kann.